Empezó un nuevo juego que no queríamos perdernos: agarramos horas de lecturas de Hernán Casciari y empezamos a jugar con clonación de voces. El futuro ya llegó.

Empezó un nuevo juego que no queríamos perdernos: agarramos horas de lecturas de Hernán Casciari y empezamos a jugar con clonación de voces. El futuro ya llegó.

Cuando les contamos que en Orsai habíamos empezado a sumergirnos en desarrollos con inteligencia artificial probablemente nos imaginaron jugando con dall.e o haciendo versiones caricaturescas de fotos nuestras. Pero saben bien que si hay algo que nos gusta es jugar en serio. Y por eso, junto a nuestros nuevos amigos de MEC —un grupo de gente increíble, a mitad de camino entre The Big Bang Theory y científicos locos—, se nos ocurrió una idea: «¿Y si hacemos un modelo que clone voces con acento rioplatense?».

La charla, un poco en broma un poco en serio, escaló enseguida: «Si pudiéramos tener un modelo con un pronunciado acento cordobés, podríamos ver una película doblada al cordobés», dijo uno. «¿Te imaginás ver una de Tarantino doblada en correntino?», propuso otro. Dos minutos más tarde estábamos parados frente a una pizarra llena de fórmulas, siglas y desarrollos: habíamos encontrado gente que, como nosotros, quería jugar en serio. Y cuando eso pasa, nos fascinamos.

A continuación, les mostramos las primeras pruebas que hicieron nuestros amigos de MEC cuando se pusieron a jugar con el modelo de voz de Hernán Casciari.

¿Qué es el clonado de voces? ¿Cómo se hace? En términos simples, es la capacidad de recrear la voz de alguien en formato digital. Se logra mediante algoritmos de aprendizaje automático que analizan y descomponen la voz de una persona en elementos más pequeños, como la entonación, el timbre y el ritmo. Luego, estos elementos se pueden manipular para crear una voz que suene muy similar a la original.

Hay muchas aplicaciones para esta tecnología: la producción de audio, la industria musical, el doblaje de películas y series, la generación de narraciones de audio y la voz de asistentes virtuales.

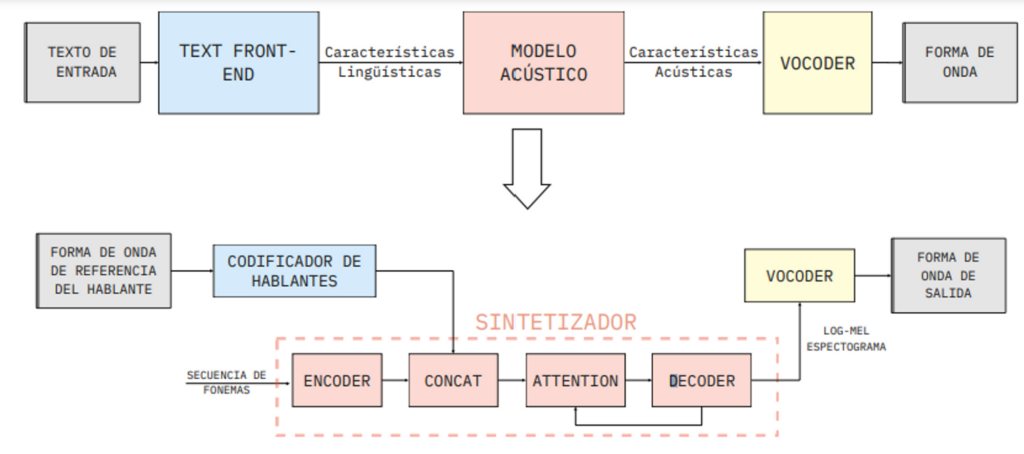

Los pasos en este complejo proceso pueden resumirse de la siguiente forma:

Recopilación de datos: el primer paso es recopilar datos de voz de la persona cuya voz se desea clonar. Los datos son fundamentales en el entrenamiento de la inteligencia artificial.

Extracción de características: a continuación, se extraen características específicas de la voz, como el tono, la duración de las sílabas, la entonación, entre otras. Estas características se utilizan más adelante para recrear la voz.

Entrenamiento del modelo: se utiliza un algoritmo de aprendizaje automático para entrenar un modelo que pueda imitar la voz de la persona original. El modelo, que se denomina sintetizador, aprende a partir de los datos de voz recopilados y las características extraídas.

Generación de la voz clonada: una vez que se ha entrenado el modelo, se genera la voz clonada. Para hacerlo, se proporciona una muestra original de la voz objetiva a clonar y el modelo utiliza las características aprendidas para crear una versión sintética de la misma voz.

Para resumir estas etapas, se puede observar el siguiente esquema y cómo cada uno de los módulos se conectan entre sí.

En la primera reunión que tuvimos con Hernán San Martín y Maximiliano Yommi (CEO y CTO de MEC, respectivamente), nos dimos cuenta que algo sonaba con los mismos acordes entre ellos y nosotros. Estábamos hablando con gente que sabía una tonelada de cosas que nosotros no, pero que atrás de todos esos bits, desarrollos y fórmulas complejas, había dos personas con ganas de jugar.

Y nos pusimos a jugar. Como conejillo de indias del modelo de voice cloning (así se llama técnicamente), les propusimos experimentar con una inteligencia artificial capaz de clonar la voz de Hernán Casciari, de quien tenemos horas y horas de grabaciones para poder entrenar un modelo que sirviera para replicar su voz, sus matices y demás.

Nos contaron que hay algo que se llama dataset, que tiene versiones, tonos y registros de muchas voces, pero que la mayoría de los desarrollos eran en inglés y que había algún modelo centroamericano y quizás español. «¿Y rioplatense?», quisimos saber. «Rioplatense nada». Entonces supimos que era por ahí.

Les pedimos, concretamente, inventar algo que no existe: un dataset de voces con acento rioplatense, capaz de clonar e interpretar no solo el lenguaje castellano, sino su tono regional: acentos tucumanos, cordobeses, sanjuaninos, y más: siendo Argentina un país tan inmenso, las variaciones de una punta a otra de su mapa son muchísimas.

Y cuando pensamos que nos iban a invitar a que nos fuéramos por la locura que le habíamos propuesto, estaban convidándonos café y haciendo garabatos en una pizarra, mucho más cebados que nosotros.